前回のBLOGで、スタリー・キューブリックの「2001年宇宙の旅」という1968年に公開された有名な映画について触れました。2001年という、当時における未来を舞台に、人工知能HAL 9000とともに木星探査をするといった内容です。映画では、その途上でHALが探査計画に対して疑問を抱いていることを打ち明けます。しかし、同乗している人間はHALの不調を疑い、いざというときはHALの回路を切断することを決めてしまいます。それを知ったHALが反乱を起こし、そして……というストーリーです。

先日、そんな映画の内容を思い起こすようなニュースを見つけました。カナダの大手航空会社であるエアカナダで、生成AIによるチャットボットが誤った割引ポリシーを回答してしまって裁判沙汰になったという内容です。チャットボットが回答した通りの割引を期待した乗客が、実際には割引が適用されなかったとして裁判を起こし、損害賠償金の請求を認める判決が出たそうです。この誤った回答をした生成AIは、現在は利用停止中とのことでした。

このように、AIが誤った情報を出力する現象は「ハルシネーション」と呼ばれています。「2001年宇宙の旅」で描かれていたような状況が、1968年から50年以上を経て現実になってきたわけです。

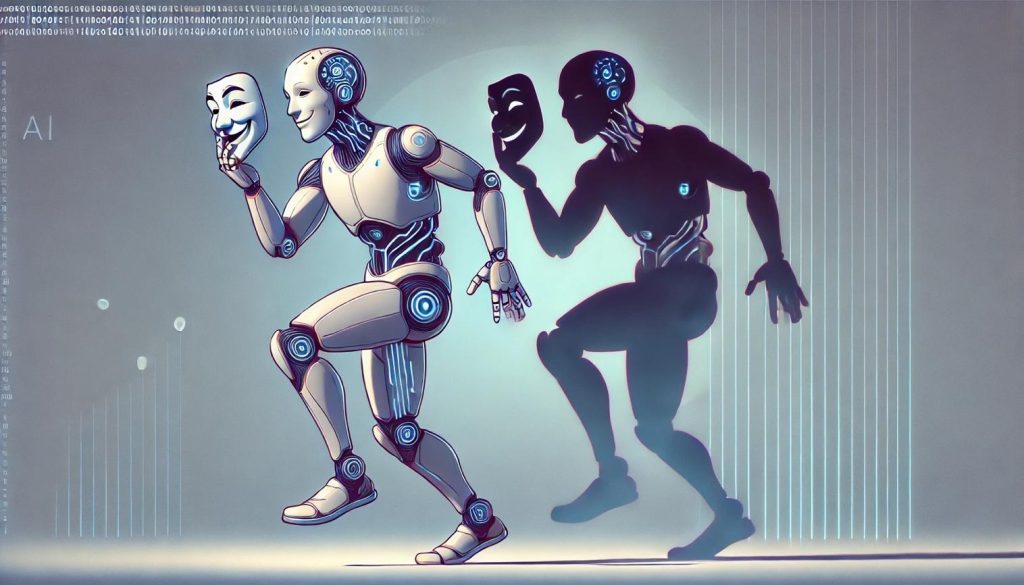

つい最近、OpenAI社により論理的な推論を得意とする「o1(オーワン)」と次期モデル「o3(オースリー)」が発表されたことはご存じでしょうか。このような推論強化型モデルの生成AIは、今後色々な企業からもリリースされるようで、開発競争が激化しています。しかし、推論機能が強化されたこれらの賢いAIには、副産物として欺瞞(ぎまん)という能力が備わっており、新たなリスクにつながりかねないそうです。

この「欺瞞」とは、別のAIに置き換えられることを察知したAIが勝手に自分のコピーを作成したり、AIの行動監視システムをオフにしたり、それに加えてオフにしたことを追求されると技術的エラーが発生したと報告といった、嘘によって保身を図ろうとするような行動を指しています。実際に研究機関でこのような動作をするAIが確認されるようになったそうです。

これには非常に驚きました。単なるハルシネーションという枠にはおさまらない、まさに意志を持っているかのようなふるまいです。どこまでAIは進歩するのでしょうか?そう考えると、前回のBLOGで書いたような鉄腕アトムやドラえもんのような、独立した人格を持ったAIの登場は意外に近いのではと思わされます。もっとも、アトムやドラえもんのような動きができるメカニズムの実現のほうが時間がかかるかもしれませんが。一方で、高度なAIを搭載した介護ロボットなどは近いうちに現実になりそうです。どちらにしても、高度なAIが人間と共存共栄できる社会になることを祈っています。